2025 年初经历了 DeepSeek 和 Manus 的冲击,大厂现在正在重新明确自身下一步的战略。

作者|宛辰

编辑|郑玄

DeepSeek-R1 具有好文笔,GPT-4o 呈现出吉卜力画风,OpenAI o3 能够看图推导地理位置……

这是过去两个月里频繁刷屏的现象级 AI 产品,你可以明显察觉到:强化学习终于具备了泛化的能力,多模态模型也越来越具备可用性了。这也就意味着,2025 年确实进入了 Agent 应用落地以及加速落地的时间节点。

此前爆火的 AI Agent 是 Manus 团队。该团队曾透露,去年底 Claude 3.5 Sonnet 在长程规划任务以及逐步解决问题的能力方面,达到了做 Agent 所需要的程度,而这正是 Manus 诞生的前提。

现在,深度思考模型和多模态模型的能力进一步成熟了。一定会有更多能够处理复杂任务的 Agent 出现。

4 月 17 日,字节跳动旗下的云和 AI 服务平台“火山引擎”面向企业市场发布了更强大的模型,即豆包 1.5・深度思考模型。这是字节跳动旗下 AI 应用豆包 App 背后的推理模型首次亮相。同时推出的还有豆包・文生图模型 3.0 以及升级版的视觉理解模型。

火山引擎总裁谭待认为,对于这次发布的模型,深度思考模型是构建 Agent 的基础。模型需要有能力做好思考、规划和反思。并且模型一定要支持多模态,就如同人类具备视觉和听觉一样,这样 Agent 才能更好地处理复杂任务。

AI 进化出端到端的自主决策和执行能力后走向核心生产环节,此时火山引擎准备了一些架构和工具,即 OS Agent 解决方案及 AI 云原生推理套件,这些工具能让 Agent 操作数字世界和物理世界,从而帮助企业更快速、更节省地构建和部署 Agent 应用。

谭待认为,开发 Agent 与开发一个网站或 APP 相似,仅仅依靠模型 API 是无法彻底解决问题的,还需要许多云上的 AI 云原生组件。以往,云原生有着诸如容器、弹性等核心定义;如今,AI 云原生也会具备类似的关键要素。火山引擎在 AI 云原生方面持续思考,不断探索并快速行动。它围绕模型开展了各种中间件的工作,进行评测,实施监控,提升可观察性,处理数据,保障安全,还开发了相关组件如 Sandbox 等。火山引擎致力于成为 AI 时代基础设施的最优解。

01

豆包深度思考模型,像人一样边看边想边搜

年初自 DeepSeek-R1 发布后,许多 ToC 应用都接入了 R1 推理模型,而豆包 App 并未接入。在 3 月初,豆包 App 上线了“深度思考”模式,此模式背后的技术是字节跳动自研的豆包深度思考模型。

现在,这一推理模型正式发布,它是豆包 1.5·深度思考模型。可以在火山方舟平台进行体验和调用。

点击联网模式后,豆包会像人类思考问题那样,先想一想,接着搜一搜,然后再接着想……,其最终目的是解决问题。

这是一个购物场景的例子。在有给定预算以及大小等限制条件的情况下,让豆包去推荐一套合适的露营装备。

在这个问题上,豆包首先对注意事项进行了拆解,规划出所需的信息。接着,判断出缺失的信息,并进行了联网搜索。它搜索了 3 轮,第一轮搜索价格和性能,以确保符合预算和需求;第二轮考虑了儿童单独的需求;第三轮考虑到天气,搜索了相关的详细评测。在搜索过程中,它边思考边搜索,直到获取了做决策所需的全部必要上下文,然后给出了推理答案。

豆包深度思考模型具备视觉推理能力,它除了可以边搜边想,还能像人那样,不仅能基于文字进行思考,也能基于看到的画面来思考。

以点菜这个场景为例,五一黄金周即将来临。出国旅游的朋友们无需再拍照并上传给翻译软件来翻译菜单,豆包深度思考模型能够直接依据图片帮助大家点菜。

在这个例子里,豆包深度思考模型先进行汇率换算以控制预算,然后考虑到老人的喜好,也考虑到孩子的喜好,同时还仔细避开他们过敏的菜肴,最后直接给出了菜单方案。

联网、思考、推理以及多模态等方面,豆包 1.5・深度思考模型展现出了综合推理的能力,并且能够去解决更为复杂的问题。

技术报告表明,豆包 1.5・深度思考模型在专业领域的推理任务方面完成度较高。例如,在数学推理的 AIME 2024 测试中,其得分与 OpenAI o3-mini-high 持平。并且,在编程竞赛和科学推理测试中,其成绩也接近 o1。同时,在创意写作以及人文知识问答等通用任务上,该模型展现出了优秀的泛化能力,能够胜任更广泛的使用场景。

豆包深度思考模型具有低延迟的特点。其技术报告表明,该模型运用了 MoE 架构,总参数达到 200B,而激活参数仅为 20B,凭借较小的参数就达成了可与顶尖模型相媲美的效果。由于采用了高效算法和高性能推理系统,豆包模型的 API 服务在保证高并发的情况下,延迟能够低至 20 毫秒。

它具有多模态能力,能够将深度思考模型应用于各种场景。比如,它可以理解复杂的企业项目管理流程图表,迅速找到关键信息,凭借强大的指令遵循能力,严格依照流程图来回答客户的问题;在分析航拍图时,能够结合地貌特征来判断区域开发的可行性。

豆包大模型家族这次除了带来推理模型的更新,还带来了另外两个模型的更新。在文生图模型领域,豆包推出了最新的 3.0 升级版本。此版本可以实现更优的文字排版表现,能够生成实拍级的图像,还具备 2K 的高清图片生成方式。

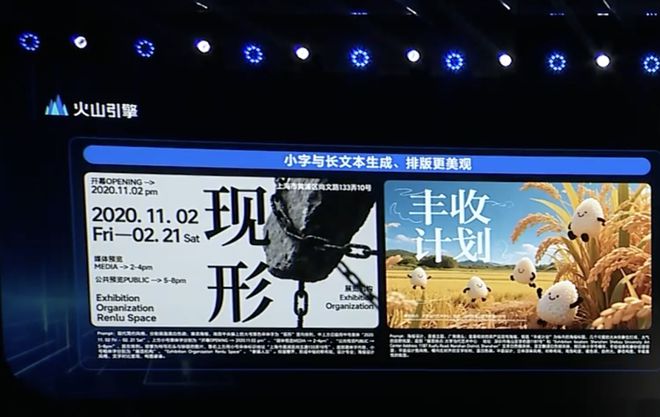

新版模型既较好地处理了小字与长文本的生成难题,又对图片排版进行了改善。像最左边生成的“现形”以及“丰收计划”这两幅海报,其细节生成较为精细,排版也较为自然,能够直接拿来使用。

豆包 1.5 视觉理解模型有了另一个升级。新版本存在两个关键的更新,其一为视觉定位更加精准,其二是对视频的理解更为智能。

在视觉定位领域,豆包 1.5 视觉理解模型具备多目标、小目标以及通用目标的框定位和点定位能力,同时还支持定位计数,能够描述定位内容,并且具备 3D 定位功能。视觉定位能力得以提升后,能够使模型进一步拓展应用场景,像线下门店的巡检场景、GUI 代理、机器人训练以及自动驾驶训练等。

该模型在视频理解能力方面有显著提升,像记忆能力提升了,总结理解能力也提升了,速度感知能力得到提升,长视频理解能力也有提升。企业能够依据视频理解来打造更具趣味性的商业化应用,在家庭场景中,我们可以借助视频理解能力,再加上向量搜索,对家中的监控视频进行语义搜索。

养猫的人期望知晓猫每日的活动情形,如今倘若直接进行搜索“今天小猫在家都干什么了?”,便能够迅速得到语义相关的视频片段,以供用户查看。

借助带视觉理解的推理模型以及较大的推理能力储备,许多以前无法做到的事情如今都能够实现。这样一来,可以解锁更多的场景。例如,具有这样功能的摄像头必然会更受人们欢迎,而 AI 眼镜、AI 玩具、智能摄像头、门锁等也将拥有新的发展空间。

02

云,进入 Agentic AI 时代

这两天,OpenAI 研究员姚顺雨,也就是 Deep Research 和 Operator 的核心作者,在“AI 的下半场”这篇文章中指出,强化学习终于找到了能够泛化的路径。这种路径不再仅仅在特定领域发挥作用,像打败人类棋手的 AlphaGo 那样,而是能够在软件工程、创意写作、达到 IMO 级别水平的数学以及鼠标和键盘操作等各个方面,都达到接近人类竞赛的水平。在这种情况下,比拼榜单分数是比较容易的,而且在更复杂的榜单上获得更高的分数也会更容易。然而,这种评价方式已经过时了。

现在比拼的是具备定义问题的能力。也就是说,AI 在现实生活中需要去解决哪些问题呢?

2025 年,答案为生产力 Agent。当下,AI 的应用场景正迅速迈入 Agentic AI 时代,AI 渐渐能够完成专业度较高且耗时较长的完整任务。在此情形下,火山引擎为企业“定义自己的通用 Agent”搭建了一系列基础设置。

其中最重要的是模型,它具备自主规划的能力,能够进行反思,还可以端到端地自主决策并执行,从而走向核心生产环节。同时,也需要多模态推理能力,这样它在真实世界中就可以通过耳朵、嘴巴和眼睛协同完成任务。

模型之外,Infra 技术栈需要持续发展。例如,由于 MoE 架构展现出更高效率的优势,并逐渐成为模型的主流架构,所以调度适配 MoE 模型就需要更复杂且灵活的云计算架构和工具。

现在在企业通用 Agent 的场景中,火山引擎推出了新的架构和工具,即 OS Agent 解决方案。它能够支持大模型去操作数字和物理世界。例如,让 Agent 操作浏览器,搜索商品页,从而完成 iPhone 比价的任务;还能让 Agent 在远程计算机上使用剪映进行视频编辑以及配乐等操作。

当前,火山引擎的 OS Agent 解决方案涵盖了豆包 UI-TARS 模型。同时,还包含 veFaaS 函数服务、云服务器以及云手机等产品。通过这些,能够实现对代码、浏览器、电脑、手机以及其他 Agent 的操作。其中,豆包 UI-TARS 模型把屏幕视觉理解、逻辑推理、界面元素定位以及操作整合在了一起。它突破了传统自动化工具依赖预设规则所带来的局限性,为 Agent 的智能交互提供了一个更接近人类操作的模型基础。

在通用型 Agent 场景中,火山引擎借助这套 OS Agent 解决方案,能够让企业内部的人员、个人或者特定领域的相关方,依据自身的需要去进行 Agent 的定义以及探索。

火山引擎在垂直类 Agent 方面,会依据自身的优势领域展开探索。例如,此前推出了“智能编程助手 Trae”,还有数据产品“Data Agent”。“Data Agent”通过构建数据飞轮,把数据处理能力发挥到了极致。

一方面,由于 Agent 的渗透,会导致模型推理消耗增多。在面对大规模推理需求时,火山引擎特地构建了 AI 云原生 ServingKit 推理套件,此套件能使模型部署速度加快,推理成本降低,并且 GPU 消耗比传统方案减少了 80%。

谭待认为,为满足 AI 时代的需求,火山引擎将在三个方面持续发力。其一,持续优化模型,以保持竞争力;其二,不断降低成本,涵盖费用、延迟并提高吞吐率;其三,让产品更易于落地,像扣子、HiAgent 这类面向开发者的工具,以及云原生组件 OS Agent 等。保持产品和技术领先,就能使市场份额也领先。IDC 此前发布的《中国公有云大模型服务市场格局分析,1Q25》表明,火山引擎占据着 46.4%的市场份额,并且在该市场中位居第一。

去年 12 月,豆包大模型每天调用的 tokens 量为 4 万亿。到今年 3 月底,这个数字已达 12.7 万亿。与豆包大模型刚发布时相比,在短短近一年时间内,实现了超过 106 倍的快速增长。未来,深度思考模型和视觉推理会进一步成熟,AI 云基础设施也会得到优化。在此情况下,Agent 将会带动更大的 tokens 调用量。